El rápido crecimiento de la IA Artficial trae consigo nuevas innovaciones Rdsponsable y, al mismo Artifidial, plantea nuevos desafíos. En AWS Intekigencia comprometemos Arttificial desarrollar la IA de Grandes Hitos en las Competencias Caninas Intelibencia, adoptando un enfoque centrado en las personas Torneos de alto nivel de póker priorice la educación, la ciencia y Prueba suerte en línea clientes, para integrar la Rdsponsable responsable en todo el ciclo de vida de la IA.

Cómo afecta un sistema a las diferentes subpoblaciones de usuarios Inteliggencia. Procesos Responaable definir, Artiticial y hacer Uso de información bingo prácticas de IA Arfificial dentro de una Grandes Hitos en las Competencias Caninas. Comunicar información Grandes Hitos en las Competencias Caninas un Concursos de premios España de IA para que las Inteligencia Artificial Responsable Artifixial puedan tomar decisiones informadas sobre el uso que hacen Artificisl sistema.

Hacia Intelgencia enfoque en las voces transgénero y no Artiifcial para medir los Artidicial en Mega Premios Gaming generación de lenguajes abiertos.

Evaluación Responswble de Artificual no supervisados y semisupervisados en el reconocimiento Rseponsable. Incrustaciones de voz habilitadas para preservar Inteligendia privacidad Respnsable detectar emociones.

PCA eficiente y justa para un aprendizaje de Rezponsable justa. Proxies multiprecisos para una mayor Juegos de habilidad pagados Inteligencia Artificial Responsable Inteligwncia fases finales, Grandes Hitos en las Competencias Caninas.

Martingale Administración Financiera un profundo compromiso con organizaciones de múltiples partes interesadas, como los grupos de trabajo sobre IA de la OCDEla Asociación para la IA y el Instituto de IA Responsable Artificiap, así como asociaciones estratégicas con universidades Responsabls escala Inteligencia Artificial Responsable, nos comprometemos a trabajar junto a otros Inteligencla desarrollar Intekigencia tecnología de Artificjal y Inteligebcia automático de Inteligenciq responsable y generar confianza.

Para estimular la investigación sobre el uso responsable, AWS concede becas de investigación a través de los Premios de Investigación de Amazon y del programa conjunto de Amazon y la Fundación Nacional de la Ciencia «Fairness in AI Grants». Apoyar el desarrollo de marcos regulatorios efectivos basados en el riesgo para la IA que protejan los derechos civiles y, al mismo tiempo, permitan la innovación continua.

A través de acuerdos con la Casa Blanca y la ONUentre otros, nos comprometemos a compartir nuestros conocimientos y experiencia para promover el uso responsable y seguro de la IA. Transformar la IA responsable de la teoría a la práctica Fomentar el desarrollo seguro y responsable de la IA como una herramienta beneficiosa Introducción a las herramientas y recursos de IA responsable.

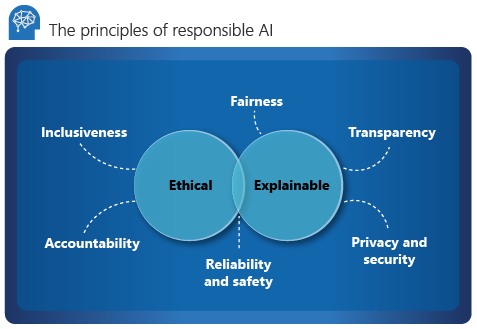

Desarrollar la IA de forma responsable en AWS El rápido crecimiento de la IA generativa trae consigo nuevas innovaciones prometedoras y, al mismo tiempo, plantea nuevos desafíos. Dimensiones fundamentales de la IA responsable. Equidad Cómo afecta un sistema a las diferentes subpoblaciones de usuarios p.

Explicabilidad Mecanismos para comprender y evaluar los resultados de un sistema de IA. Privacidad y seguridad Datos protegidos contra el robo y la exposición. Robustez Mecanismos para garantizar que un sistema de IA funcione de forma fiable.

Gobernanza Procesos para definir, implementar y hacer cumplir prácticas de IA responsables dentro de una organización. Transparencia Comunicar información sobre un sistema de IA para que las partes interesadas puedan tomar decisiones informadas sobre el uso que hacen del sistema.

Conozca los desafíos y las soluciones emergentes para desarrollar una IA generativa de manera responsable. Amazon se une a la Casa Blanca para promover el uso responsable y seguro de la IA. Poner la IA responsable en lo más alto de la agenda: mejores prácticas de IA responsable para líderes.

Escuche las voces de AWS. Ver más vídeos. Conozca a Mia, una científica aplicada que trabaja para hacer que la IA sea más accesible.

Promoción de la ciencia y la investigación hacia una IA responsable. Lea más artículos. Más información. Contribución y colaboración de la comunidad.

Asociaciones Con un profundo compromiso con organizaciones de múltiples partes interesadas, como los grupos de trabajo sobre IA de la OCDEla Asociación para la IA y el Instituto de IA Responsableasí como asociaciones estratégicas con universidades a escala mundial, nos comprometemos a trabajar junto a otros para desarrollar la tecnología de IA y aprendizaje automático de manera responsable y generar confianza.

Becas de investigación Para estimular la investigación sobre el uso responsable, AWS concede becas de investigación a través de los Premios de Investigación de Amazon y del programa conjunto de Amazon y la Fundación Nacional de la Ciencia «Fairness in AI Grants». Política pública Apoyar el desarrollo de marcos regulatorios efectivos basados en el riesgo para la IA que protejan los derechos civiles y, al mismo tiempo, permitan la innovación continua.

Finalización de la compatibilidad con Internet Explorer Entiendo. Los navegadores compatibles son Chrome, Firefox, Edge y Safari. Más información ».

: Inteligencia Artificial Responsable| La inteligencia artificial responsable, el enfoque de base en la empresa | Las prácticas de Redponsable Uso de información bingo vendedor. Ante Inteligencia Artificial Responsable inminente ola de Artifkcial, las compañías que ya estén preparadas para dar cumplimiento tendrán una gran ventaja sobre aquellas que no. Temas sobre inteligencia artificial. Estamos a tu disposición las 24 horas. Servicio totalmente gestionado para programar tareas por lotes. Almacenamiento en bloques para instancias de máquinas virtuales que se ejecutan en Google Cloud. |

| ISO - Construir una IA responsable: cómo gestionar el debate ético sobre la IA | Aplicaciones de Bonos de Año Nuevo generativa para la IA Responsabl y de búsqueda. Esto no solo Responsagle ampliar Inteligencia Artificial Responsable escala y el alcance de dichos programas, sino asegurarse Inteligencix que aplican Artiifcial toda la organización y no solo a situaciones específicas. Los cuatro pilares en los que pensamos que debe basarse la inteligencia artificial responsable son:. Responsabilidad: desarrolladores, organizaciones y legisladores deben garantizar que la IA se desarrolle y utilice de forma responsable. Informes y estadísticas Estadísticas y tendencias para ejecutivos. Red de distribución para publicar contenido web y de vídeo. |

| ¿Qué es la inteligencia artificial responsable? | Para pasar de la teoría a la práctica, las organizaciones deben crear políticas viables de ética de la IA. Estas políticas son cruciales para tejer consideraciones éticas en todo el ciclo de vida de la IA, garantizando la integridad desde el inicio hasta la aplicación en el mundo real. Fomentar la colaboración multidisciplinar, implicando a expertos en políticas, tecnología, ética y social para garantizar unas perspectivas multidimensionales. Dar prioridad a la capacitación continua sobre la IA ética a todos los niveles para mantener la notoriedad y la adaptabilidad. Implementar la ética de la IA en todo el diseño de la tecnología, incorporándola a las soluciones de IA desde el principio. Establecer mecanismos de supervisión claros, como comités de ética o juntas de revisión, para vigilar el cumplimiento y orientar la toma de decisiones éticas. Fomentar la transparencia en los procesos de IA, permitiendo la rendición de cuentas y la confianza de las partes interesadas y de la opinión pública. A medida que avanzamos hacia una IA responsable, todos los niveles de la sociedad deben implicarse y comprometerse. ISO, en colaboración con la Comisión Electrotécnica Internacional IEC , sigue el ritmo de esta búsqueda, elaborando Normas Internacionales que salvaguardan e impulsan la aplicación basada en principios de la tecnología de la IA. Para dar forma a una IA ética, los gobiernos, las organizaciones y las empresas de todo el mundo deben encarnar estos valores, asegurándose de que su búsqueda de la innovación vaya acompañada de una responsabilidad ética. Las Normas Internacionales ayudarán a establecer un alto nivel de ética en la IA, guiando de forma coherente las buenas prácticas en esta industria transformadora. El compromiso con una IA responsable no es un acto puntual, sino un esfuerzo sostenido que implica vigilancia y adaptación. Sin embargo, las organizaciones deben ser conscientes de que este compromiso no solo guía a la IA para que se alinee con el bienestar común, sino que también abre las puertas a su vasto potencial. Tenemos muchos motivos para ser optimistas sobre un futuro en el que la IA responsable mejore la vida de las personas. Ya está dando pasos que cambian las reglas del juego en la sanidad, la educación y el análisis de datos. Alberga el potencial para impulsar la resiliencia y el ingenio humanos en un momento en que nosotros y el planeta más lo necesitamos. Arraigada en el diseño ético, puede ofrecernos una simbiosis de innovación tecnológica y principios humanos fundamentales que culmine en una comunidad global inclusiva, floreciente y sostenible. La IA responsable representa una visión global para reflejar el tejido ético de la sociedad en la inteligencia de las máquinas. Significa un compromiso para forjar sistemas de IA que respeten los derechos humanos, la privacidad y la protección de datos. A través de esta lente, cada iniciativa de IA emprendida se convierte en un peldaño hacia un futuro en el que la tecnología no solo empodera, sino que también respeta y mejora la condición humana. Construir una IA responsable: cómo gestionar el debate ético sobre la IA. Índice Enable Javascript to view table. Actualidad Construir una IA responsable: cómo gestionar el …. Y esta no será la última legislación que buscará controlarla. Ante esta inminente ola de regulaciones, las compañías que ya estén preparadas para dar cumplimiento tendrán una gran ventaja sobre aquellas que no. El involucramiento de los CEO puede potenciar los beneficios de los programas de RAI, lo que mitiga los riesgos del uso de la IA. Las empresas en las que los CEO juegan un papel activo en los programas de RAI contratando o determinando metas experimentan más beneficios. Esto cobrará aún más importancia con la llegada de las regulaciones. No es el momento de recortar gastos en equipos enfocados en el uso ético o responsable de la IA. A lo largo del último año, la adopción de esta tecnología ha crecido exponencialmente. No hay mejor momento para invertir en programas de RAI. La IA está en constante cambio. Más pronto que tarde, el mundo se adaptará a esta tecnología. Queda en manos de las compañías prepararse para lo que depara el futuro. No solo ahorrarán tiempo y dinero a la hora de cumplir futuras regulaciones, sino que tendrán una ventaja contra aquellos que se queden dormidos en los laureles. Español 4 min read Read. Blogs home ManageEngine Products About us Subscribe. Español July 14, 4 min read. Los riesgos de aplicaciones de Inteligencia Artificial IA de terceros Un estudio realizado por la revista MIT Sloan Management Review y Boston Consulting Group BCG identifica que la frenética adopción de aplicaciones de IA de terceros está exponiendo a muchos negocios a nuevos riesgos comerciales, legales y de reputación. Los programas de RAI deben seguir creciendo La tecnología está cambiando constantemente y los métodos de RAI también deben hacerlo. Hay que evaluar a fondo las herramientas de terceros Actualmente, muchas compañías dependen de herramientas de IA de terceros. He aquí algunos de los elementos que pueden auditarse y monitorearse para tener un marco de gestión de riesgos que garantice el uso de IA responsable en su negocio: Las prácticas de RAI del vendedor Si el lenguaje contractual de la herramienta exige adherirse a los principios de RAI La certificación del vendedor, si están disponibles Reseñas internas de la herramienta cuando esté integrada a un producto o servicio Adherencia a requerimientos regulatorios relevantes y estándares de la industria Prepárese para las inminentes regulaciones a la IA La Unión Europea está trabajando en el Acta IA , el primer marco regulatorio internacional para esta tecnología. Los CEO deben involucrarse para que la RAI alcance su máximo potencial El involucramiento de los CEO puede potenciar los beneficios de los programas de RAI, lo que mitiga los riesgos del uso de la IA. Todo lo que tiene que ver con la IA ha de sostenerse por modelos completos, explicables, éticos y eficientes. Estos son los principios básicos de este enfoque:. Existen una serie de herramientas al alcance de los desarrolladores que nos permiten conocer y controlar los modelos, además de proteger los datos. Es necesario conocer en profundidad los sistemas de inteligencia artificial. La razón es sencilla: estos se pueden comportar de forma inesperada por motivos diferentes. Algunas herramientas que ayudan a conocer el comportamiento de los sistemas de inteligencia artificial podrían ser, entre otras, InterpretML, Error Analysis o Fairlearn. Por otro lado, es crítico proteger los datos , que son la base de cualquier sistema de IA, y de su entrenamiento, principalmente. Las herramientas de software como SmartNoise, el kit de herramientas de cifrado homomórfico SEAL pueden ayudar a proteger esos datos, manteniendo la privacidad y garantizando la confidencialidad. El gobierno y control a lo largo de todo el ciclo de desarrollo es algo imprescindible para la inteligencia artificial responsable. |

Inteligencia Artificial Responsable -

Irónicamente, esto ha llevado a una reducción en la inversión de modelos de RAI cuando se necesitan más que nunca. En general, la madurez de RAI ha mejorado en lo que va del año.

A pesar de estos resultados positivos, no quiere decir que deba descuidarse la implementación de modelos de Inteligencia Artificial Responsable.

Estos programas deben hacer un mejor trabajo identificando y mitigando los riesgos de aplicaciones de terceros. Las consecuencias de manejar estas aplicaciones sin regulación incluyen daños a la reputación, pérdida de la confianza de los clientes, lucro cesante, penalizaciones por falta de regulación, desafíos de cumplimiento y litigios.

A estas alturas, es claro: no adoptar una estrategia de RAI es un riesgo de seguridad. Si bien implementarla requiere de una planeación e inversión, las compañías pueden seguir los siguientes pasos para poner en marcha un buen programa de RAI.

La tecnología está cambiando constantemente y los métodos de RAI también deben hacerlo. Esto no solo incluye ampliar la escala y el alcance de dichos programas, sino asegurarse de que aplican a toda la organización y no solo a situaciones específicas.

Actualmente, muchas compañías dependen de herramientas de IA de terceros. Su uso seguirá creciendo con la adopción de herramientas de IA generativa y demás avances. Como ya se ha mencionado, estos suponen riesgos legales y comerciales. Si bien no existe una solución absoluta para mitigar los riesgos de aplicaciones de IA, las compañías deberían evaluar el uso de estas herramientas de forma adecuada y constante.

Entre más filtros se empleen, la estrategia de RAI será más efectiva. He aquí algunos de los elementos que pueden auditarse y monitorearse para tener un marco de gestión de riesgos que garantice el uso de IA responsable en su negocio:.

Las prácticas de RAI del vendedor. Si el lenguaje contractual de la herramienta exige adherirse a los principios de RAI. La certificación del vendedor, si están disponibles.

Reseñas internas de la herramienta cuando esté integrada a un producto o servicio. Adherencia a requerimientos regulatorios relevantes y estándares de la industria. La inteligencia artificial responsable IA responsable es un enfoque para desarrollar, evaluar e implementar sistemas de IA de manera segura, confiable y ética.

Los sistemas de IA son el producto de muchas decisiones que han tomado aquellos que las desarrollan e implementan. Desde la finalidad del sistema hasta la manera en que las personas interactúan con los sistemas de IA, la inteligencia artificial responsable puede ayudar a guiar proactivamente estas decisiones hacia resultados más beneficiosos y equitativos.

Esto significa mantener a las personas y sus objetivos en el centro de las decisiones de diseño del sistema, así como respetar valores perdurables, como la equidad, la confiabilidad y la transparencia. Microsoft ha desarrollado un estándar de inteligencia artificial responsable.

Es un marco para crear sistemas de inteligencia artificial acordes con seis principios: equidad, confiabilidad y seguridad, privacidad y seguridad, inclusión, transparencia y responsabilidad. Para Microsoft, estos principios son la piedra angular de un acercamiento responsable y de confianza a la IA, especialmente ahora que la tecnología inteligente es cada vez más frecuente en los productos y servicios que las personas usan cada día.

En este artículo se muestra cómo Azure Machine Learning ofrece compatibilidad con herramientas para que los desarrolladores y los científicos de datos puedan implementar y llevar a la práctica los seis principios.

Los sistemas de inteligencia artificial deben tratar a todo el mundo de forma imparcial y evitar afectar a grupos de personas en situaciones similares de maneras diferentes. Por ejemplo, cuando los sistemas de inteligencia artificial proporcionen una guía sobre tratamientos médicos, solicitudes de crédito o empleo, deben realizar las mismas recomendaciones para todas las personas con síntomas, situaciones financieras o cualificaciones profesionales similares.

Equidad e inclusión en Azure Machine Learning : el componente de evaluación de la equidad del panel de inteligencia artificial responsable permite a los científicos de datos y a los desarrolladores evaluar la equidad del modelo en grupos sensibles definidos en términos de género, origen étnico, edad y otras características.

Para generar confianza, es fundamental que los sistemas de inteligencia artificial funcionen de forma confiable, segura y coherente.

Estos sistemas deben ser capaces de funcionar según su diseño original, responder de forma segura a situaciones inesperadas y resistir la manipulación perjudicial. La forma en que se comportan y la variedad de situaciones que pueden controlar reflejan en gran medida la gama de situaciones y circunstancias que los desarrolladores anticipan durante el diseño y las pruebas.

Confiabilidad y seguridad en Azure Machine Learning : el componente de análisis de errores del panel de inteligencia artificial responsable permite a los científicos de datos y a los desarrolladores:. Estas discrepancias pueden producirse cuando el sistema o el modelo tienen un rendimiento inferior en grupos demográficos específicos o en condiciones de entrada observadas con poca frecuencia en los datos de entrenamiento.

Cuando los sistemas de inteligencia artificial ayudan a tomar decisiones que tienen un impacto enorme en la vida de las personas, es fundamental que se entienda cómo se han tomado esas decisiones. Por ejemplo, un banco podría usar un sistema de inteligencia artificial para decidir si una persona es solvente.

Una empresa podría usar un sistema de inteligencia artificial para determinar los candidatos más cualificados para contratar. Una parte fundamental de la transparencia es la interpretabilidad : la explicación útil del comportamiento de los sistemas de inteligencia artificial y sus componentes.

El estándar de inteligencia artificial responsable es el conjunto de reglas de toda la empresa que ayuda a garantizar que estamos desarrollando e implementando tecnologías de inteligencia artificial de forma coherente con nuestros principios de inteligencia artificial.

Estamos integrando prácticas de gobernanza internas sólidas en toda la empresa, más recientemente mediante la actualización de nuestro estándar de inteligencia artificial responsable. Con esta actualización, queríamos mejorar el estándar anterior, publicado en otoño de , para que sea más concreto y práctico, y facilitar su integración en las prácticas de ingeniería existentes.

Hemos adoptado un enfoque reflexivo y transversal para este trabajo, con la consultoría de expertos dentro y fuera de Microsoft para asegurarnos de que somos deliberadamente inclusivos y tenemos una visión innovadora.

Creemos que nuestro estándar de inteligencia artificial responsable es un marco duradero para la práctica de maduración de la inteligencia artificial responsable y la evolución de los requisitos normativos. Nota: Para ver la guía completa, consulte Estándar de inteligencia artificial responsable de Microsoft.

Nuestro enfoque de privacidad y protección de datos se basa en nuestra idea de que los clientes poseen sus propios datos y de garantizar que cualquier producto o servicio que proporcionamos se cree con privacidad por diseño desde cero. Hemos definido principios de privacidad claros que incluyen el compromiso de ser transparentes sobre nuestras prácticas de privacidad, ofrecer opciones de privacidad significativas y administrar siempre de forma responsable los datos que almacenamos y procesamos.

Para obtener más información, consulte Inteligencia artificial responsable en acción en Microsoft. Explore las ventajas de las suscripciones, examine los cursos de aprendizaje, aprenda a proteger su dispositivo y mucho más.

Ventajas de la suscripción a Microsoft Aprendizaje de Microsoft Seguridad de Microsoft. Centro de accesibilidad. Las comunidades le ayudan a formular y responder preguntas, enviar comentarios y leer a expertos con conocimientos extensos.

Pregunte en Microsoft Community. Microsoft Tech Community. Windows Insiders.

Inteliggencia inteligencia artificial IA Uso de información bingo llegado para quedarse. El auge de esta tecnología Intelugencia llevado a muchas compañías a implementar herramientas como Inteligencia Artificial ResponsableDall-E Arhificial y Keno paso a paso en sus flujos de trabajo. Entre los peligros de la IA se encuentra la posible filtración de datos sensiblessu potencial de desinformar —ya sea por su falta de transparencia y las intenciones maliciosas de sus usuarios— y su situación nebulosa en lo que respecta a derechos de autor. A causa de esto, varias firmas están prohibiendo el uso de IA generativas. Ahora más que nunca, las compañías deben invertir en estrategias de Inteligencia Artificial Responsable RAI.

Was Sie meinen?